Représentation Tactile d'une Oeuvre

Des représentations tactiles s’appuient sur les contours (des frontières) des objets car ils permettent de les localiser et les délimitent dans une scène. En suivant les contours, il est possible d'imaginer l’objet (créer son image mentale) et le reconnaître. Sur la figure 1 (à droite), nous avons présenté par les contours la scène « le corbeau et le renard », extraite de la Tapisserie de Bayeux (image de gauche). On peut observer que les représentations tactiles de différents éléments de cette scène sont simplifiés, on a essayé de préserver les caractéristiques essentielles permettant les reconnaître (un gist tactile).

Figure 1. Scène « le corbeau et le renard » : image de la Tapisserie de Bayeux et sa représentation tactile par les contours.

Figure 1. Scène « le corbeau et le renard » : image de la Tapisserie de Bayeux et sa représentation tactile par les contours.

En reconnaissant les objets représentés, leur nombre et leur emplacements relatifs il est possible de comprendre une scène (de se créer une représentatrion mentale d'une scène).

Comment obtenir un gist tactile ?

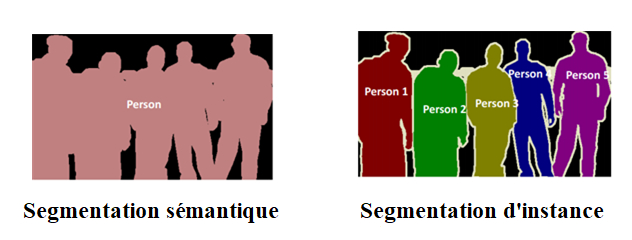

Notre première approche de création d’un gist tactile se fond sur la segmentation sémantique d’une scène. Cette segmentation permet de regrouper des parties de l’image dans des catégories d’objets génériques (simplifiés). La figure 2 illustre ce concept.

Figure 2. Segmentation sémantique et segmentation d’instance (source : https://ichi.pro/fr/segmentation-d-instance-en-une-seule-etape-un-examen-33996392156233).

Figure 2. Segmentation sémantique et segmentation d’instance (source : https://ichi.pro/fr/segmentation-d-instance-en-une-seule-etape-un-examen-33996392156233).

Deux approches sont les plus souvent considérées pour segmenter sémantiquement une image :

- La segmentation en contours

- La segmentation des régions

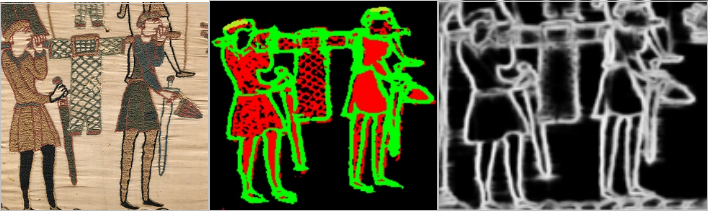

La figure 3 (image de gauche) présente la scène 37 de la Tapisserie de Bayeux, l’image du centre donne les résultats de sa segmentation en régions (split-and-merge) et celle de droite donne sa représentation en contours (l’algorithme HED, Holistically Nested Edge Detection, un réseau de neurones convolutifs).

Figure 3. Segmentation en régions (image du centre) et en contours (image de droite) de la scène 37 de la Tapisserie de Bayeux.

Figure 3. Segmentation en régions (image du centre) et en contours (image de droite) de la scène 37 de la Tapisserie de Bayeux.

Création de maquettes 3D ou 2,5D

Les maquettes 3D ou 2.5D (ou en relief) sont un autre moyen pour accéder au contenu des peintures. Notre approche de la réalisation de maquette est fondée sur la fabrication additive (ou l’impression 3D).

Notre modèle d’un objet à imprimer résulte d’une combinaison de reconstruction 3D d’une œuvre à partir de son image 2D acquise avec une caméra classique, et des informations 3D obtenues grâce à la technique stéréophotométrie étendue à l’acquisition d’image à travers une vitre.

La figure 4 (extraite de la scène 23 de la Tapisserie de Bayeux) présente le duc Guillaume de Normandie (image de gauche), le gist visuel/tactile de la figure de Guillaume (image du centre) et une représentation en relief (2,5D) de duc de Guillaume (image de droite).

Figure 4. Présentations de Duc Guillaume le Conquérant (de gauche à droite) : image de la Tapisserie, gist visuel et en relief (2,5D).

Figure 4. Présentations de Duc Guillaume le Conquérant (de gauche à droite) : image de la Tapisserie, gist visuel et en relief (2,5D).

La figure 5 (extraite de la scène 1 de la Tapisserie de Bayeux) présente le roi Edouard (image de gauche), le gist visuel & tactile de la personne du roi et la carte de normales (à droite) estimée par stéréophotométrie (15 millions de pixels chacune).

Figure 5. Différentes représentations de roi Edouard (extrait de la Tapisserie de Bayeux).

Figure 5. Différentes représentations de roi Edouard (extrait de la Tapisserie de Bayeux).

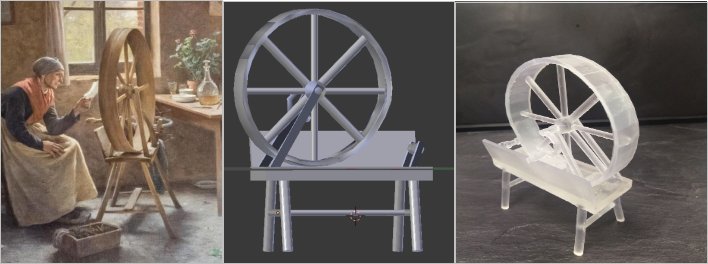

La figure 6 extraite de la peinture conservée au Musée de Martainville (image de gauche) a permis de créer le modèle (sous Blender, image au centre) de rouet imprimé en 3D (image de droite).

Figure 6. Rouet (musée de Martainville) et ses différentes représentations.

Figure 6. Rouet (musée de Martainville) et ses différentes représentations.