Représentation Tactile d'une Oeuvre

Pour les personnes présentant une incapacité visuelle

Une œuvre se doit avant tout d’avoir des contours mis en évidence pour détecter les objets représentés, leur nombre et leur emplacement relatif aux autres objets faisant partie de cette œuvre. Pour distinguer les objets dans l’image (premier et deuxième plan), la simplification de l’image doit permettre une meilleure compréhension pour l’observateur qui aura ainsi la connaissance des frontières et catégories d’objets représentés.

La perspective, élément visuel, gêne la reconnaissance. Un objet dessiné, simplement mis en relief (2D ½) a peu de rapport avec l’expérience tactile de cet objet. La projection d’un objet sur une surface correspond toujours à des repères visuels. Sa reconnaissance dépend des hypothèses culturelles de notre mémoire. Il faut donc apprendre à interpréter ce type d’images. Une représentation tactile doit être simplifiée par rapport à une représentation visuelle en ne conservant que l’information essentielle permettant sa reconnaissance. Elle doit « préserver le sens global » de l’objet représenté [1].

Segmentation Sémantique

Une segmentation sémantique permet de regrouper des parties de l’image dans des catégories simplifiées. Deux approches sont possibles pour appréhender la simplification d’une œuvre d’art : (1) Détection de contours des éléments visibles dans le tableau ; (2) Segmentation des régions appartenant à un élément par rapport aux autres régions.

Ces deux classes de méthodes ont pour objectif de simplifier l’image en éliminant ou simplifiant grandement les informations contenues (couleurs, détails, etc.) et en séparant le contenu en zones grossières correspondant aux frontières d’éléments connus, permettant de faciliter l’interprétation de l’organisation spatiale du contenu de l’image.

Détection de contour

La détection de contours consiste à repérer les bords des éléments saillants d’un tableau par rapport au contraste des pixels. Les méthodes classiques (filtres passe-haut/sharpening kernels, Canny, etc.) ne permettent pas d’avoir des contours complets car elles sont tributaires de l’éclairage et de la texture des images.

L’approche HED (Holistically Nested Edge Detection) est une architecture de réseaux de neurones convolutifs de bout en bout [[2]](#ref2) inspiré par les réseaux de neurones entièrement convolutifs. Basée sur la perception humaine dans la recherche des contours des objets, elle utilise les différents niveaux de perception, l’information structurelle, le contexte.

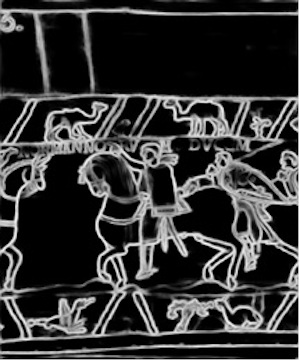

Scène 23, Tapisserie de Bayeux

Contours calculés avec la méthode HED de la scène 23 de la Tapisserie de Bayeux

Segmentation en Régions

La segmentation d’une image consiste à séparer ses éléments en objets distincts. Ces méthodes comprennent plusieurs approches dont (1) K-means, algorithme de regroupement de régions (clustering). (2) Modèle de mélanges Gaussiens [3] : méthode d’apprentissage qui sert à estimer la distribution de variables aléatoires en les modélisant comme une somme de plusieurs gaussiennes, et se calcule itérativement via l’algorithme Espérance-Maximisation (EM). (3) Deeplab V3 [4] : Réseau de neurones convolutif profond, utilisé pour la segmentation sémantique des images naturelles. Il se caractérise par une architecture Encodage-Décodage. (4) Slic Superpixels [[5]](#ref5) : divise l’image en groupes de pixels connectés avec des couleurs similaires.

Notre approche : Un prétraitement est effectué pour choisir l’objet de façon semi-automatique : Nous appliquons la méthode Mean-shift pour uniformiser les couleurs (moins de clusters), ensuite la méthode grabcut pour extraire un objet et réduire l’erreur induite par la proximité spatiale.

Sur l’objet extrait, nous appliquons GMM (car K-means induit une erreur supérieure) pour obtenir une segmentation en régions de notre image.

Ensuite, pour un découpage plus intuitif tactile avec des détails pertinents et du relief, on applique HED (contours) sur l’image GMM (régions). On obtient des contours simplifiés, plus lisses et plus faciles à suivre tactilement.